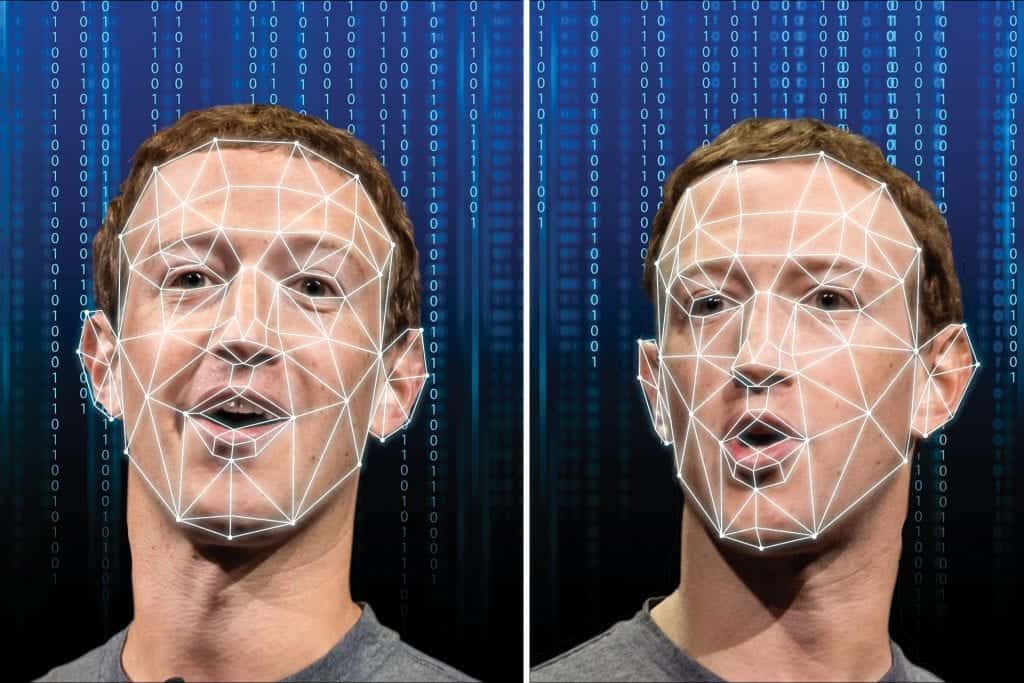

El gigante estadounidense Meta anunció el martes que identificará en los próximos meses cualquier imagen generada por inteligencia artificial que aparezca en sus redes sociales.

Meta anunció que en los próximos meses empezará a identificar imágenes generadas con inteligencia en sus redes Facebook, Instagram y Threads.

El presidente de Asuntos Globales, Nick Clegg, señala que Meta está trabajando con otras empresas de la industria en estándares técnicos comunes para identificar contenido de IA, incluidos videos y audios.

Estamos creando herramientas líderes en la industria que pueden identificar marcadores invisibles para que podamos etiquetar imágenes de Google, OpenAI, Microsoft, Adobe, Midjourney y Shutterstock, destacó Clegg.

Los usuarios también pueden usar Meta AI para crear imágenes fotorrealistas mediante texto. No obstante, la empresa señala que ellos recalcan que la IA ha participado en algún proceso de la creación de la imagen con marcadores visibles. Esto se pueden ver en las imágenes y marcas de agua invisibles y metadatos incrustados en los archivos de imagen.

La Junta de Supervisión de Meta apoyó que permaneciera en sus redes un video manipulado del presidente de Estados Unidos, Joe Biden, que salió a la luz este enero.

Además del riesgo político, el desarrollo de programas de IA generativa podría producir un flujo incontrolable de contenidos degradantes, según numerosos activistas y reguladores, como las imágenes falsas deepfakes pornográficas de mujeres famosas, un fenómeno que también afecta a muchas personas anónimas.